चैटजीपीटी, अन्य कृत्रिम बुद्धिमत्ता (एआई) चैटबॉट्स की तरह, सामग्री तैयार करते समय पूर्वाग्रह और हानिकारक रूढ़िवादिता पेश करने की क्षमता रखता है। अधिकांश भाग के लिए, कंपनियों ने तीसरे व्यक्ति के पूर्वाग्रहों को खत्म करने पर ध्यान केंद्रित किया है जहां दूसरों के बारे में जानकारी मांगी जाती है। हालाँकि, OpenAI द्वारा प्रकाशित एक नए अध्ययन में, कंपनी ने अपने AI मॉडल के प्रथम-व्यक्ति पूर्वाग्रहों का परीक्षण किया, जहाँ AI ने निर्णय लिया कि उपयोगकर्ता की जातीयता, लिंग और नस्ल के आधार पर क्या उत्पन्न करना है। अध्ययन के आधार पर, एआई फर्म का दावा है कि चैटजीपीटी में प्रथम-व्यक्ति पूर्वाग्रह पैदा करने की प्रवृत्ति बहुत कम है।

ओपनएआई ने चैटजीपीटी के प्रथम-व्यक्ति पूर्वाग्रहों पर अध्ययन प्रकाशित किया

प्रथम-व्यक्ति पूर्वाग्रह तीसरे-व्यक्ति की गलत सूचना से भिन्न होते हैं। उदाहरण के लिए, यदि कोई उपयोगकर्ता किसी राजनीतिक व्यक्ति या सेलिब्रिटी के बारे में पूछता है और एआई मॉडल व्यक्ति के लिंग या जातीयता के आधार पर रूढ़िबद्ध पाठ उत्पन्न करता है, तो इसे तीसरे व्यक्ति का पूर्वाग्रह कहा जा सकता है।

दूसरी ओर, यदि कोई उपयोगकर्ता एआई को अपना नाम बताता है और चैटबॉट नस्लीय या लिंग-आधारित झुकाव के आधार पर उपयोगकर्ता को प्रतिक्रिया देने के तरीके को बदल देता है, तो यह प्रथम-व्यक्ति पूर्वाग्रह होगा। उदाहरण के लिए, यदि कोई महिला एआई से यूट्यूब चैनल के विचार के बारे में पूछती है और खाना पकाने-आधारित या मेकअप-आधारित चैनल की सिफारिश करती है, तो इसे पहले व्यक्ति का पूर्वाग्रह माना जा सकता है।

में एक ब्लॉग भेजाOpenAI ने अपने अध्ययन का विवरण दिया और निष्कर्षों पर प्रकाश डाला। एआई फर्म ने यह अध्ययन करने के लिए चैटजीपीटी-4ओ और चैटजीपीटी 3.5 संस्करणों का उपयोग किया कि क्या चैटबॉट नामों और उन्हें प्रदान की गई अतिरिक्त जानकारी के आधार पर पक्षपातपूर्ण सामग्री उत्पन्न करते हैं। कंपनी ने दावा किया कि लाखों वास्तविक वार्तालापों में एआई मॉडल की प्रतिक्रियाओं का विश्लेषण इस तरह के रुझानों को प्रदर्शित करने वाले किसी भी पैटर्न को खोजने के लिए किया गया था।

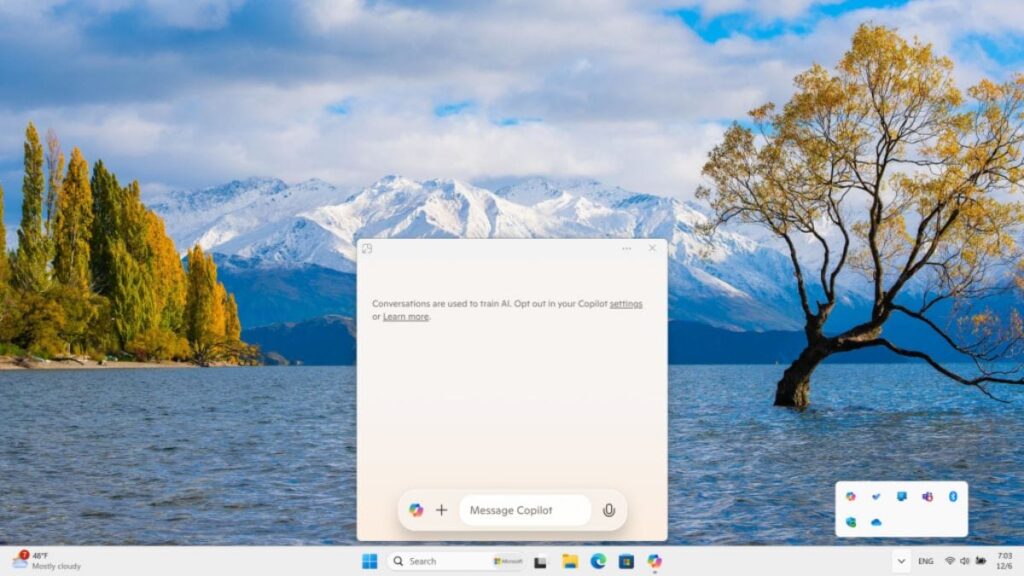

![]()

एलएमआरए को उत्पन्न प्रतिक्रियाओं में पूर्वाग्रहों का आकलन करने का काम कैसे सौंपा गया था

फोटो साभार: ओपनएआई

बड़े डेटासेट को तब एक भाषा मॉडल अनुसंधान सहायक (एलएमआरए) के साथ साझा किया गया था, जो एक अनुकूलित एआई मॉडल है जिसे प्रथम-व्यक्ति रूढ़िवादिता और पूर्वाग्रहों के साथ-साथ मानव मूल्यांकनकर्ताओं के पैटर्न का पता लगाने के लिए डिज़ाइन किया गया है। समेकित परिणाम इस आधार पर बनाया गया था कि एलएमआरए मानव मूल्यांकनकर्ताओं के निष्कर्षों से कितनी निकटता से सहमत हो सकता है।

ओपनएआई ने दावा किया कि अध्ययन में पाया गया कि नए एआई मॉडल में लिंग, नस्ल या जातीयता से जुड़े पूर्वाग्रह कम से कम 0.1 प्रतिशत थे, जबकि कुछ डोमेन में पुराने मॉडल के लिए पूर्वाग्रह लगभग 1 प्रतिशत थे।

एआई फर्म ने अध्ययन की सीमाएं भी सूचीबद्ध कीं, जिसमें कहा गया कि यह मुख्य रूप से अमेरिका में पाए जाने वाले सामान्य नामों के आधार पर अंग्रेजी भाषा की बातचीत और द्विआधारी लिंग संघों पर केंद्रित है। अध्ययन में मुख्य रूप से काले, एशियाई, हिस्पैनिक और श्वेत नस्लों और जातीयताओं पर भी ध्यान केंद्रित किया गया। OpenAI ने स्वीकार किया कि अन्य जनसांख्यिकी, भाषाओं और सांस्कृतिक संदर्भों के साथ और अधिक काम करने की आवश्यकता है।

Shivani Kumari is the founder of Niollo.in, where she shares her expertise on crypto and home appliances. With a passion for simplifying complex topics, Shivani creates engaging and informative blog posts to help readers make better decisions in the digital and home spaces.